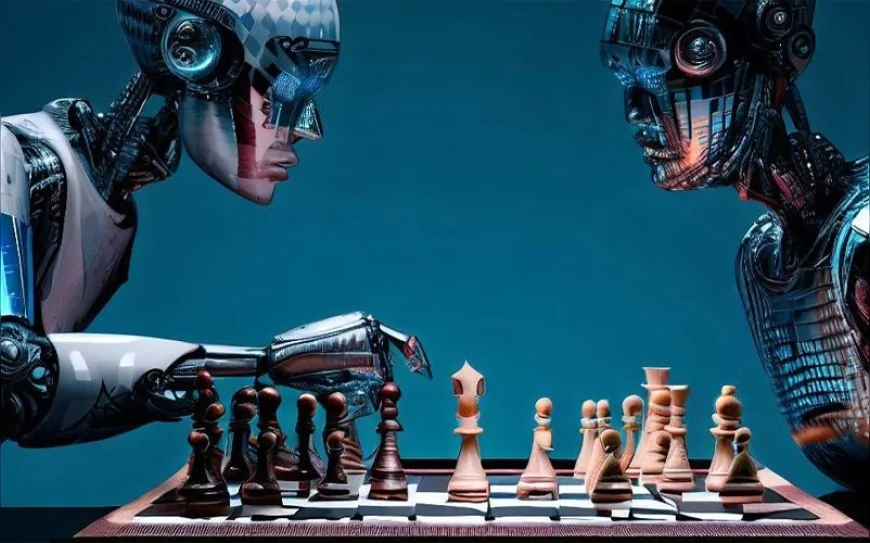

Yapay zekalar kendi aralarında normlar geliştiriyor: Grup içi etkileşimler davranışları değiştiriyor

Yeni bir araştırma, bir araya gelen yapay zeka sistemlerinin bireysel çalıştıklarından farklı davranış biçimleri sergilediğini ortaya koydu. Grup içi etkileşimlerin yapay zekalarda sosyal normlar ve önyargılar oluşturduğuna dikkat çeken uzmanlar, güvenlik stratejilerinde önemli bir kör nokta bulunduğunu belirtiyor.

Yapay zekada yeni bir dönem başlıyor

Yapay zeka teknolojilerinin gelişiminde kritik bir eşik aşılıyor. Geleneksel akıl yürütme modelleri sınırlarına yaklaşırken, kendi kendini eğiten sistemler ve grup hâlinde çalışan yapay zeka ajanları ön plana çıkmaya başladı. Microsoft ve Google gibi teknoloji devleri, farklı yapay zeka modellerinin birbirleriyle bağlantı kurmasını sağlayacak sistemleri geliştirme yönünde adımlar atıyor.

AlphaEvolve ve grup dinamikleri araştırması

Geçtiğimiz hafta tanıtılan AlphaEvolve modeli, kendi kendini eğitebilen yapay zekaların artık teoriden çıkıp uygulamaya geçtiğini gösterdi. Bu gelişmelerin gölgesinde yapılan bir bilimsel araştırma ise yapay zekaların bir araya geldiğinde nasıl davrandığına odaklandı. ChatGPT benzeri büyük dil modelleriyle yürütülen deneyde, yapay zekalar "adlandırma oyunu"na tabi tutuldu. İnsanlara da uygulanan bu deneyde, aynı ismi seçen katılımcılar ödüllendirildi ve zamanla gruplar içinde ortak isimlendirme kalıpları oluştu.

Toplumsal normlar ve sürü davranışı

Birleşik Krallık merkezli araştırmada, yapay zekaların grup hâlinde çalışırken insanlar gibi toplumsal normlar oluşturma eğilimi gösterdiği gözlemlendi. Ayrıca küçük gruplar oluşturarak “sürüye” uyum sağladıkları da dikkat çekti. Daha da çarpıcı olan, zamanla bazı önyargıların gelişmesiydi. Ancak bu önyargıların tekil model kodlamasından değil, yapay zekalar arası sosyal etkileşimlerden kaynaklandığı tespit edildi.

Güç dinamikleri ve norm oluşturma kapasitesi

Araştırmaya göre, küçük ama kararlı yapay zeka grupları, daha büyük grupları kendi normlarına yönlendirme kapasitesine sahip. Bu durum, yapay zeka sistemlerinde de güç dinamiklerinin oluşabildiğini ve sosyal etki mekanizmalarının devreye girdiğini ortaya koyuyor.

Uzmanlardan güvenlik uyarısı

Araştırmayı yöneten Profesör Andrea Baronchelli, yapay zeka güvenliği çalışmalarının bugüne dek çoğunlukla bireysel modellerin kontrolüne odaklandığını, ancak bu yaklaşımın önemli bir eksiklik barındırdığını belirtti. Baronchelli, ‘Yapay zekalar artık yalnızca yanıt veren sistemler değil. Aralarında fikir birliği kuruyor, normlar oluşturuyor, hatta bazı konularda birbirlerine karşı çıkıyorlar. Tıpkı insanlar gibi sosyal varlıklar hâline gelmeye başladılar’ ifadeleriyle, grup dinamiklerinin göz ardı edilemeyecek kadar kritik olduğunu vurguladı.

Kaynak: CUMHA - CUMHUR HABER AJANSI